Comment fonctionnent les crawlers web ? Guide technique complet

Découvrez comment fonctionnent les crawlers web, des URLs sources à l'indexation. Comprenez le processus technique, les types de crawlers, les règles robots.txt...

Découvrez ce qu’est le Google Spider (Googlebot), comment il explore et indexe les sites web, et pourquoi il est essentiel pour le SEO. Apprenez à optimiser votre site pour une meilleure exploration.

Le Google Spider, officiellement appelé Googlebot, est un programme automatisé qui explore les sites web pour découvrir, indexer et stocker leur contenu dans la base de données de Google. Il suit les liens pour trouver de nouvelles pages ou des pages mises à jour, qui sont ensuite traitées et ajoutées à l’index de recherche de Google, permettant ainsi au moteur de recherche de fournir des résultats pertinents aux utilisateurs.

Le Google Spider, plus formellement connu sous le nom de Googlebot, est un programme logiciel automatisé qui explore systématiquement Internet pour découvrir, analyser et indexer le contenu web. Il s’agit de l’outil principal utilisé par Google pour explorer les sites web, collecter des informations et construire son immense index de recherche. Sans Googlebot, Google ne pourrait pas découvrir de nouvelles pages, détecter les mises à jour de contenu existant, ni fournir des résultats de recherche pertinents à des milliards d’utilisateurs dans le monde. Le spider fonctionne en continu, visitant des millions de sites chaque jour pour assurer que l’index de Google reste à jour et complet.

Googlebot est essentiellement un robot d’exploration sophistiqué qui suit un processus algorithmique complexe pour déterminer quels sites visiter, à quelle fréquence les explorer et combien de pages extraire de chaque domaine. Le robot lit le code HTML, le contenu textuel et les métadonnées de chaque page visitée, puis stocke ces informations dans la base de données centrale de Google. Ce processus d’indexation est fondamental au fonctionnement des moteurs de recherche et a une incidence directe sur la visibilité de votre site dans les résultats de recherche.

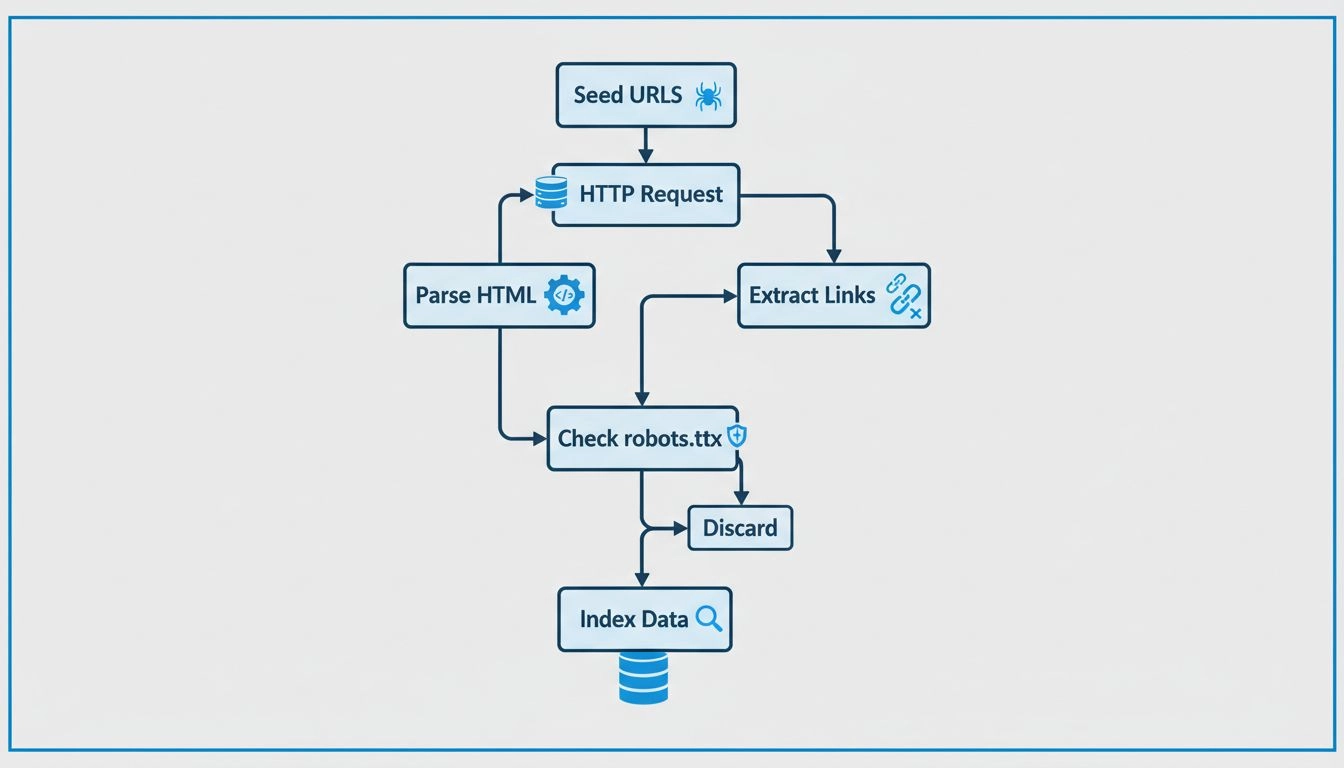

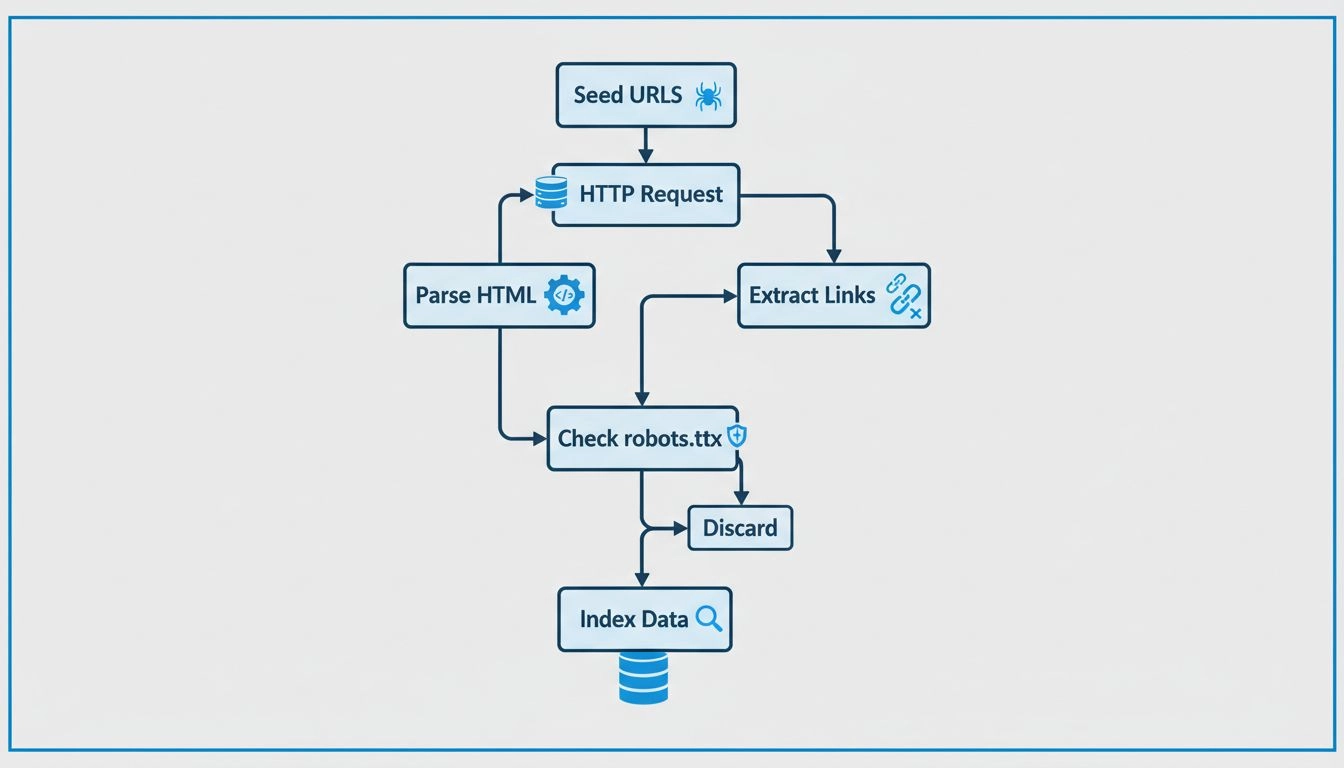

Le Google Spider suit un processus d’exploration bien défini qui commence par une liste de pages web connues, appelée « seed list ». Cette liste initiale est générée à partir des précédents processus d’exploration et est continuellement enrichie par les données de sitemap fournies par les webmasters via la Google Search Console. Lorsque Googlebot visite un site, il ne se contente pas de lire le contenu : il analyse en profondeur la structure de la page, suit les liens internes et externes, et identifie les changements ou nouveaux contenus ajoutés depuis sa dernière visite.

Le processus d’exploration suit ces étapes clés : premièrement, Googlebot commence avec une liste d’URLs issues des explorations précédentes et des sitemaps. Deuxièmement, il navigue sur les sites en suivant les liens (attributs SRC et HREF) sur chaque page pour découvrir de nouveaux contenus. Troisièmement, le robot récupère et analyse le contenu de chaque page, y compris le texte, la structure HTML, les métadonnées et d’autres informations pertinentes. Quatrièmement, ces données collectées sont envoyées aux serveurs de Google pour traitement et stockage dans l’index de recherche. Enfin, Googlebot revisite régulièrement les sites pour vérifier la présence de nouveaux contenus, de mises à jour ou de modifications sur les pages existantes.

Google exploite plusieurs variantes spécialisées de Googlebot, chacune conçue pour des usages spécifiques et identifiée par des chaînes user-agent uniques. Comprendre ces différents types aide les propriétaires de sites à optimiser leur site pour le robot approprié. Les principales variantes de Googlebot incluent le robot d’exploration pour ordinateur, pour mobile, pour la vidéo, pour l’image et pour les actualités, chacun jouant un rôle distinct dans l’écosystème d’indexation de Google.

| Type de Googlebot | Chaîne User-Agent | Utilisation |

|---|---|---|

| Googlebot (Desktop) | Mozilla/5.0 (compatible; Googlebot/2.1; +http://www.google.com/bot.html) | Explore les versions ordinateur des sites pour l’index de recherche général |

| Googlebot (Mobile) | Mozilla/5.0 (Linux; Android 6.0.1; Nexus 5X Build/MMB29P) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/W.X.Y.Z Mobile Safari/537.36 (compatible; Googlebot/2.1; +http://www.google.com/bot.html) | Explore les versions mobiles des sites web |

| Googlebot-Video | Googlebot-Video/1.0 | Indexe le contenu vidéo intégré dans les pages web |

| Googlebot-Image | Googlebot-Image/1.0 | Explore et indexe les images pour la recherche Google Images |

| Googlebot-News | Googlebot-News | Explore les contenus d’actualités pour l’agrégateur Google Actualités |

Au-delà de ces robots principaux, Google utilise aussi des bots spécialisés pour d’autres usages. Le robot AdSense vérifie la qualité et la conformité des annonces, tandis que le robot Mobile Apps Android indexe le contenu des applications Android. Chaque bot possède un identifiant user-agent distinct, permettant aux administrateurs de sites de savoir quel robot accède à leur site via les logs du serveur. Cette distinction est importante car chaque robot peut disposer d’un budget et de priorités d’exploration différents, impactant la fréquence de visite de votre site.

Le Google Spider est absolument essentiel pour l’optimisation des moteurs de recherche, car il détermine si le contenu de votre site est découvert, indexé et classé dans les résultats de recherche. Si Googlebot ne peut pas explorer efficacement votre site, vos pages n’apparaîtront pas dans l’index de Google, les rendant invisibles pour les visiteurs potentiels recherchant vos produits ou services. C’est pourquoi le SEO technique — garantir que votre site est compatible avec les robots — est l’un des piliers de toute stratégie SEO réussie.

Lorsque Googlebot explore votre site, il compile un index massif de tous les mots trouvés et de leur emplacement sur chaque page, ainsi que des informations HTML telles que les balises title, les meta descriptions et la structure des titres. Ces informations indexées sont stockées dans la base de données de Google et utilisées par les algorithmes de recherche pour classer les pages et déterminer la valeur de votre contenu pour des requêtes spécifiques. Plus Googlebot peut explorer efficacement votre site, plus il reviendra fréquemment, et plus rapidement vos nouveaux contenus seront indexés et potentiellement classés dans les résultats de recherche.

Pour que Googlebot explore efficacement votre site, il est nécessaire d’appliquer plusieurs bonnes pratiques techniques. D’abord, maintenez une structure de site claire et logique avec une navigation adaptée qui facilite la découverte de toutes les pages importantes par le robot. Le maillage interne doit être stratégique et pertinent, utilisant un texte d’ancrage descriptif qui aide à la fois les utilisateurs et les robots à comprendre le contexte des pages liées. Votre site doit se charger rapidement, car la vitesse de chargement est un facteur influençant l’efficacité d’exploration et la quantité de pages explorées dans le budget alloué à Googlebot.

Créez et soumettez un sitemap XML via la Google Search Console, ce qui fournit à Googlebot une liste complète de toutes les pages que vous souhaitez voir indexées. Ceci est particulièrement important pour les grands sites ou ceux dont certaines pages ne sont pas facilement accessibles via le maillage interne. En outre, assurez-vous que votre fichier robots.txt est correctement configuré pour permettre à Googlebot d’accéder aux pages à indexer, tout en bloquant l’accès aux zones sensibles ou au contenu dupliqué. Attention cependant à ne pas bloquer accidentellement des pages importantes, ce qui empêcherait leur indexation.

La Google Search Console est un outil essentiel pour surveiller la façon dont Googlebot interagit avec votre site et identifier d’éventuels problèmes d’exploration pouvant empêcher l’indexation. La section Statistiques d’exploration fournit des informations détaillées sur le nombre de pages explorées par Googlebot, le temps passé à explorer votre site, et les erreurs rencontrées. Vous pouvez voir le temps de réponse moyen de votre serveur, qui influe directement sur l’efficacité d’exploration de vos pages : un serveur lent signifie moins de pages explorées dans la même période.

Le rapport de couverture de la Search Console indique quelles pages ont été indexées avec succès, lesquelles rencontrent des erreurs empêchant leur indexation, et quelles pages sont exclues de l’index. Ces informations sont précieuses pour repérer des problèmes techniques tels que des liens cassés, des erreurs serveur ou des pages bloquées par robots.txt sans que vous l’ayez souhaité. Vous pouvez également utiliser l’outil d’inspection d’URL pour tester la façon dont Googlebot voit une page spécifique, y compris sa capacité à traiter le contenu JavaScript et à accéder à toutes les ressources nécessaires pour afficher correctement la page.

Chaque site dispose d’un « budget d’exploration » — le nombre de pages que Googlebot explorera sur votre site dans une période donnée. Pour la plupart des sites, le budget n’est pas une contrainte, mais pour les très grands sites comportant des milliers ou millions de pages, optimiser le budget devient important. Google attribue ce budget selon deux facteurs : la capacité d’exploration (ce que votre serveur peut supporter) et la demande d’exploration (l’importance que Google accorde à votre site). Améliorer la vitesse de votre site et corriger les erreurs d’exploration augmente la capacité, tandis que créer un contenu de qualité et régulièrement mis à jour accroît la demande.

Pour optimiser votre budget d’exploration, éliminez le contenu dupliqué qui gaspille des ressources, corrigez les liens cassés et les chaînes de redirections, et supprimez les pages sans valeur pour les utilisateurs. Évitez de bloquer des pages importantes via robots.txt ou des balises noindex, et veillez à ce que votre architecture permette à Googlebot de découvrir toutes les pages importantes en quelques clics depuis la page d’accueil. Mettez à jour régulièrement votre sitemap XML et retirez les pages obsolètes pour que Googlebot concentre ses efforts sur le contenu ayant le plus d’impact pour votre entreprise.

Les propriétaires de sites rencontrent souvent divers problèmes empêchant Googlebot d’explorer efficacement leur site. Les erreurs serveur (codes 5xx) indiquent que votre serveur a des difficultés à répondre aux requêtes, ce qui peut empêcher l’indexation de certaines pages. Les chaînes de redirections — lorsqu’une page redirige vers une autre qui redirige encore — gaspillent le budget d’exploration et ralentissent l’indexation. Les ressources bloquées, comme les fichiers CSS ou JavaScript interdits par robots.txt, peuvent empêcher Googlebot de bien afficher et comprendre vos pages.

Les erreurs Soft 404 se produisent lorsqu’une page renvoie un code 200 (succès) mais contient peu ou pas de contenu, ce qui embrouille Googlebot sur la nécessité d’indexer la page. Des balises noindex appliquées par erreur à des pages importantes les empêchent d’apparaître dans les résultats de recherche. Des temps de chargement lents réduisent le nombre de pages explorées dans le budget alloué. Pour résoudre ces problèmes, auditez régulièrement votre site avec la Search Console, surveillez les logs serveur pour détecter les erreurs d’exploration, et utilisez des outils comme Screaming Frog pour repérer les problèmes techniques avant qu’ils n’affectent votre visibilité.

En 2025, le Google Spider reste aussi important que jamais, même si son rôle a évolué pour intégrer de nouvelles technologies et formats de contenu. Googlebot gère désormais le rendu JavaScript, ce qui lui permet d’explorer et d’indexer le contenu généré dynamiquement par des frameworks JavaScript. Il traite aussi les données structurées (Schema.org) pour mieux comprendre le contenu des pages et fournir des extraits enrichis dans les résultats de recherche. L’indexation mobile-first implique que Googlebot accorde la priorité à la version mobile de votre site, rendant l’optimisation mobile indispensable pour le SEO.

Le spider joue également un rôle crucial dans la capacité de Google à détecter et combattre le spam, identifier le contenu piraté, et garantir la pertinence et la fiabilité des résultats de recherche. À mesure que les moteurs de recherche évoluent avec l’IA et le machine learning, les capacités d’exploration et d’indexation de Googlebot deviennent encore plus sophistiquées, permettant à Google de mieux comprendre l’intention des utilisateurs et de fournir des résultats toujours plus précis. Comprendre le fonctionnement de Googlebot et optimiser votre site en conséquence reste l’un des aspects les plus fondamentaux de la stratégie SEO.

Tout comme Google Spider explore et indexe votre contenu, PostAffiliatePro vous aide à suivre et optimiser vos performances en marketing d’affiliation. Surveillez chaque clic, conversion et commission grâce à notre plateforme leader de gestion d’affiliation.

Découvrez comment fonctionnent les crawlers web, des URLs sources à l'indexation. Comprenez le processus technique, les types de crawlers, les règles robots.txt...

Les crawlers accumulent des données et des informations sur Internet en visitant des sites web et en lisant leurs pages. Découvrez-en plus à leur sujet.

Les spiders sont des robots créés pour le spamming, pouvant causer de nombreux problèmes à votre entreprise. Découvrez-en plus à leur sujet dans cet article....

Consentement aux Cookies

Nous utilisons des cookies pour améliorer votre expérience de navigation et analyser notre trafic. See our privacy policy.