Pourquoi les tests A/B sont-ils importants ?

Découvrez pourquoi les tests A/B sont cruciaux pour l’optimisation des conversions. Apprenez comment les tests A/B améliorent les conversions, réduisent les ris...

Découvrez comment fonctionne le split testing grâce à notre guide complet. Découvrez la méthodologie, la signification statistique, les meilleures pratiques et comment PostAffiliatePro aide à optimiser vos campagnes d’affiliation grâce à des tests basés sur les données.

Le split testing, également appelé test A/B, consiste à diviser votre audience en deux groupes égaux et à présenter à chaque groupe une version différente d'une page web, d'un email ou d'une ressource numérique. En mesurant la performance de chaque version selon des indicateurs clés comme le taux de conversion, vous pouvez déterminer quelle version est la plus efficace et mettre en place la variante gagnante pour optimiser vos résultats.

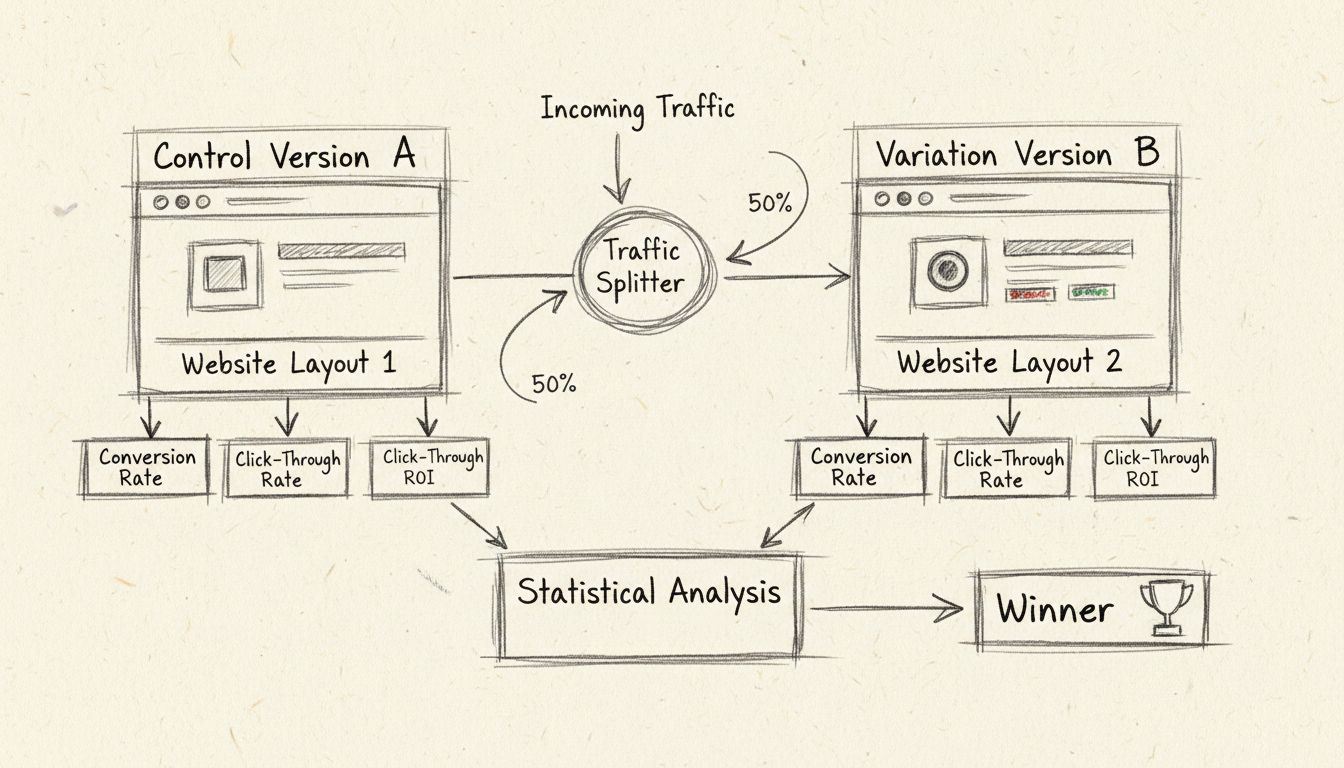

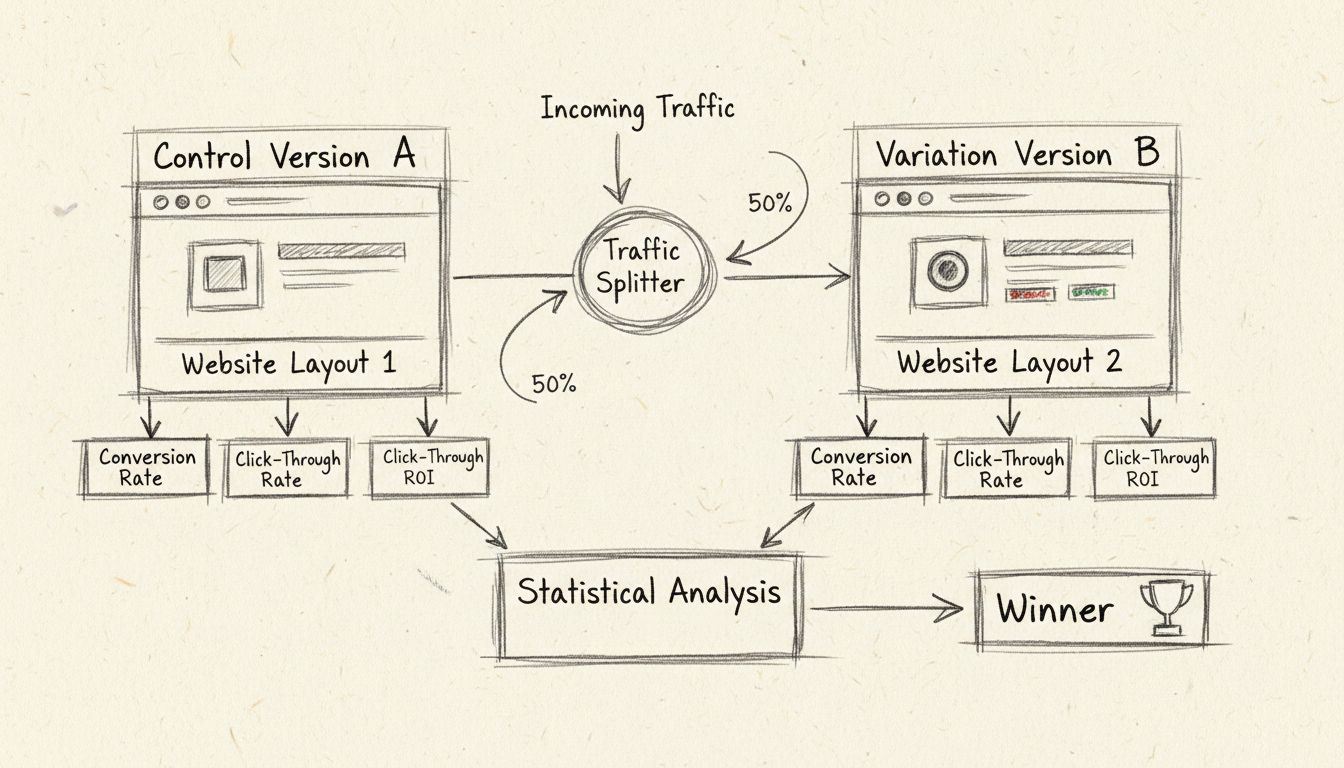

Le split testing, couramment appelé test A/B ou bucket testing, est une méthodologie d’expérimentation contrôlée qui compare deux ou plusieurs versions d’une ressource numérique afin de déterminer laquelle fonctionne le mieux. Le principe de base est élégamment simple : divisez votre audience en segments aléatoires et égaux et exposez chaque segment à une version différente de votre page web, email, publicité ou autre support marketing. En mesurant des indicateurs de performance tels que les taux de conversion, les taux de clics, les niveaux d’engagement ou le chiffre d’affaires généré, vous pouvez prendre des décisions basées sur les données quant à la version à adopter définitivement. Cette approche élimine les suppositions dans l’optimisation marketing et les remplace par des preuves empiriques, ce qui en fait l’un des outils les plus puissants pour les marketeurs et gestionnaires d’affiliation modernes.

La différence fondamentale entre le split testing et d’autres méthodes d’optimisation réside dans sa dépendance à l’analyse statistique et à des conditions contrôlées. Au lieu d’apporter des modifications fondées sur l’intuition, les préférences personnelles ou des retours anecdotiques, le split testing fournit une preuve chiffrée de ce qui fonctionne réellement auprès de votre audience spécifique. Cela est particulièrement précieux en marketing d’affiliation, où même de petites améliorations du taux de conversion peuvent se traduire par des augmentations significatives de revenus sur l’ensemble de votre réseau.

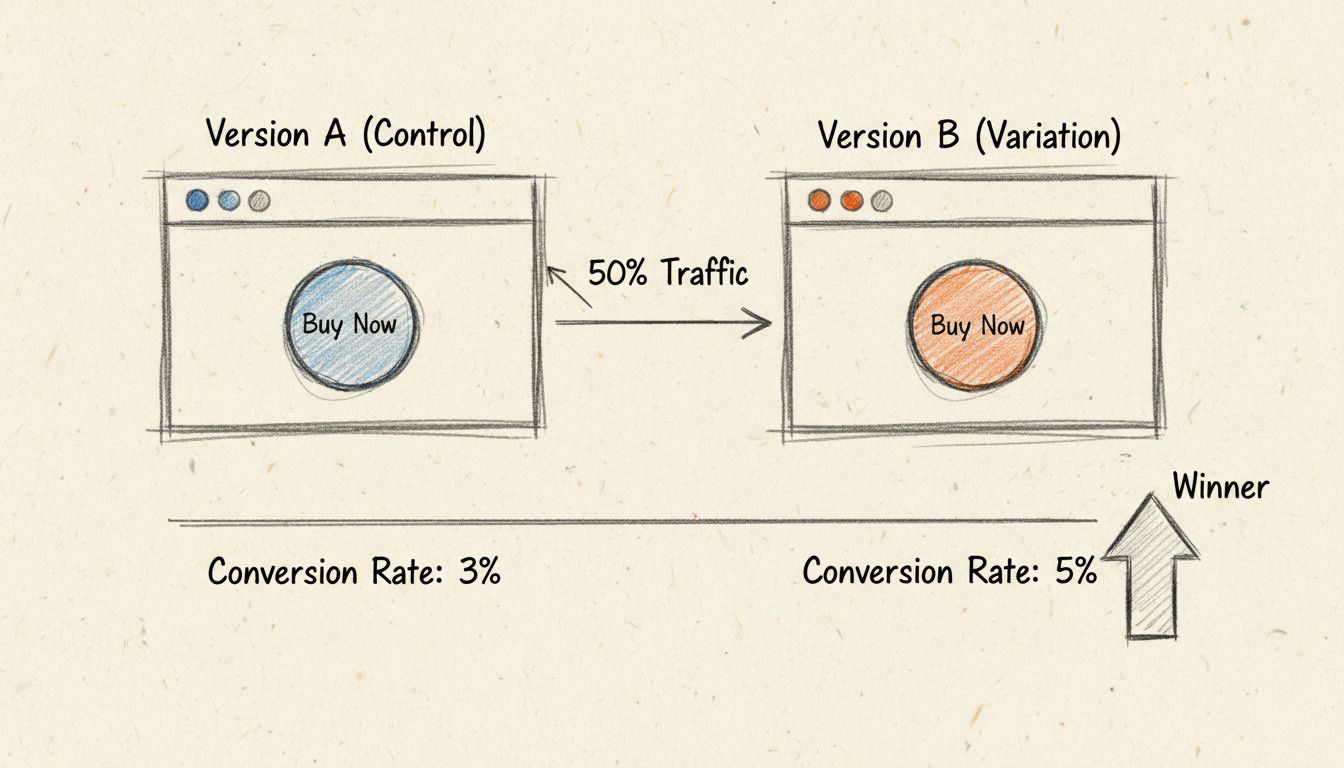

Le processus de split testing commence par l’identification d’un élément spécifique à optimiser. Il peut s’agir de la couleur d’un bouton d’appel à l’action, de l’objet d’un email, du titre d’une page de destination ou d’une image produit. Vous créez alors deux versions : le contrôle (votre version originale) et la variante (la version modifiée avec un ou plusieurs changements). Le principe clé ici est de ne modifier qu’une seule variable à la fois, pour garantir que toute différence de performance peut être directement attribuée à ce changement spécifique et non à plusieurs facteurs confondants.

Une fois vos versions prêtes, vous mettez en place un mécanisme de répartition du trafic qui affecte aléatoirement les visiteurs entrants soit au contrôle, soit à la variante. Idéalement, cette répartition doit être de 50/50, c’est-à-dire que la moitié de votre audience voit la version A et l’autre moitié la version B. Cette randomisation est essentielle pour éliminer les biais de sélection et garantir la comparabilité statistique des deux groupes. Les outils modernes de split testing automatisent ce processus, en utilisant des algorithmes pour assurer une attribution véritablement aléatoire et éviter qu’un même utilisateur ne voie plusieurs versions.

Au fur et à mesure que le trafic se répartit sur les deux versions, la plateforme de test collecte des données sur la façon dont les utilisateurs interagissent avec chaque version. Cela inclut le suivi des indicateurs de succès prédéfinis—qu’il s’agisse d’envois de formulaires, d’achats, d’ouvertures d’emails, de clics sur des liens ou de toute autre action significative. Les données s’accumulent au fil du temps, et une analyse statistique est réalisée pour déterminer si les différences constatées sont statistiquement significatives ou simplement dues au hasard.

L’un des aspects les plus critiques du split testing que beaucoup de marketeurs négligent est la notion de signification statistique. Un résultat statistiquement significatif signifie que vous pouvez être confiant que la différence observée entre votre contrôle et votre variante est réelle et non simplement due au hasard. La norme du secteur pour la signification statistique est de 95 %, ce qui signifie qu’il n’y a que 5 % de probabilité que les résultats soient dus au hasard.

Atteindre la signification statistique nécessite une taille d’échantillon adéquate. Si vous réalisez un test avec seulement 10 visiteurs par variante, les fluctuations aléatoires pourraient facilement fausser vos résultats. Cependant, avec des milliers de visiteurs par variante, les tendances deviennent claires et fiables. La taille d’échantillon requise dépend de plusieurs facteurs : votre taux de conversion de base, l’effet minimal détectable (l’amélioration minimale que vous souhaitez détecter) et votre niveau de confiance souhaité. Par exemple, si votre taux de conversion de base est de 2 % et que vous souhaitez détecter une amélioration relative de 25 % (le portant à 2,5 %), vous aurez besoin d’une taille d’échantillon plus grande que si vous testiez une amélioration de 100 %.

Il existe deux principales approches statistiques utilisées dans le split testing : la méthode Fréquentiste et la méthode Bayésienne. L’approche fréquentiste nécessite des tailles d’échantillon plus importantes et des périodes de test plus longues pour atteindre la signification statistique, ce qui la rend moins idéale pour les sites web à faible trafic. L’approche bayésienne, de plus en plus populaire dans les plateformes de test modernes, permet d’obtenir des conclusions exploitables avec des échantillons plus petits et sur des périodes plus courtes—parfois 50 % plus rapidement que les méthodes fréquentistes. Cela rend les tests bayésiens particulièrement pertinents pour les programmes d’affiliation et les sites à moindre trafic.

| Élément | Description | Importance |

|---|---|---|

| Hypothèse | Prédiction claire du changement qui améliorera la performance et pourquoi | Critique - guide tout le test |

| Version Contrôle | Votre version originale non modifiée servant de référence | Essentiel - point de comparaison |

| Variante | La version modifiée avec un ou plusieurs changements spécifiques | Essentiel - teste votre hypothèse |

| Répartition du trafic | Attribution aléatoire des visiteurs au contrôle ou à la variante (généralement 50/50) | Critique - assure des résultats impartiaux |

| Indicateur de succès | Le KPI spécifique mesuré (conversions, CTR, revenu, etc.) | Critique - définit la notion de « gagnant » |

| Taille d’échantillon | Nombre de visiteurs/interactions nécessaires pour la signification statistique | Critique - détermine la fiabilité du test |

| Durée du test | Durée du test avant l’analyse | Important - impacte la qualité des données |

| Niveau de confiance | Seuil de certitude statistique (généralement 95 %) | Important - détermine la validité du résultat |

Le split testing ne se limite pas à un seul canal ou type de support. Les gestionnaires d’affiliation et les marketeurs peuvent appliquer cette méthodologie à de nombreux points de contact. Pour les campagnes d’emailing, vous pouvez tester les objets, le texte d’aperçu, le nom de l’expéditeur, la couleur des boutons d’appel à l’action ou la structure du contenu de l’email. Tester uniquement l’objet d’un email peut révéler des différences importantes dans les taux d’ouverture—certaines entreprises ont observé des améliorations de 20 à 30 % rien qu’en optimisant cet élément.

Pour les pages d’atterrissage, les opportunités de split testing sont nombreuses. Vous pouvez tester des titres, des images principales, des champs de formulaire, le placement des boutons, des éléments de preuve sociale comme les témoignages, le message de la proposition de valeur ou même la mise en page complète. Le test A/B des pages d’atterrissage est particulièrement précieux en affiliation car même de légères améliorations du taux de conversion se répercutent sur l’ensemble de votre réseau.

Les objets d’email méritent une attention particulière car ils influencent directement les taux d’ouverture, qui ont ensuite un impact sur les taux de clics et de conversion. Tester des variantes comme la personnalisation (« Jean, voici votre offre exclusive » vs « Offre exclusive à découvrir »), l’urgence (« Offre limitée : 48h seulement » vs « Nouvelle offre disponible »), ou un message axé sur l’avantage (« Économisez 40 % sur les fonctionnalités premium » vs « Boostez votre productivité dès maintenant ») peut produire des résultats surprenants.

Les plateformes de publicité payante comme Google Ads et Meta intègrent des capacités natives de split testing. Vous pouvez tester le texte publicitaire, les titres, les images, les vidéos, les boutons d’appel à l’action et les pages de destination. Tester plusieurs variations simultanément permet d’identifier les éléments créatifs qui résonnent le mieux auprès de votre audience cible.

Étape 1 : Identifier les opportunités – Analysez vos données de performance actuelles à l’aide d’outils comme Google Analytics. Recherchez les pages ou campagnes à fort trafic mais à faible taux de conversion, taux de rebond élevé ou faibles indicateurs d’engagement. Ce sont des candidates idéales pour le split testing car elles ont le plus de potentiel d’amélioration et un volume de trafic suffisant pour atteindre rapidement la signification statistique.

Étape 2 : Formuler une hypothèse – Sur la base de votre analyse et de votre compréhension du comportement utilisateur, développez une hypothèse précise sur le changement qui améliorera la performance. Par exemple : « Ajouter des témoignages clients au-dessus de la ligne de flottaison augmentera le taux de conversion de 15 % car la preuve sociale réduit l’anxiété d’achat. » Une bonne hypothèse est spécifique, mesurable et justifiée.

Étape 3 : Créer des variantes – Développez vos variantes de test en ne modifiant qu’un seul élément à la fois. Si vous testez une page d’atterrissage, gardez tout identique sauf le titre. Si vous testez un email, changez uniquement l’objet tout en gardant le corps du message et le CTA identiques. Cette isolation permet d’attribuer de façon certaine toute différence de performance au changement spécifique.

Étape 4 : Configurer le test – Utilisez votre plateforme de split testing pour paramétrer le test. Précisez le pourcentage de trafic alloué à chaque variante (généralement 50/50), définissez vos indicateurs de succès, le niveau de confiance, et l’effet minimal détectable. La plupart des plateformes modernes gèrent automatiquement la randomisation et le partage du trafic.

Étape 5 : Lancer le test – Lancez votre test et laissez-le tourner jusqu’à atteindre la signification statistique. C’est crucial : interrompre un test prématurément sous prétexte que les premiers résultats semblent prometteurs est une erreur fréquente qui conduit à des conclusions non fiables. Des facteurs comme l’heure, le jour de la semaine, les variations saisonnières et la diversité des sources de trafic peuvent tous influencer les résultats, donc une durée de test suffisante est essentielle.

Étape 6 : Analyser les résultats – Une fois la signification statistique atteinte, analysez les résultats. Comparez contrôle et variante selon vos indicateurs prédéfinis. Si la variante l’emporte, adoptez-la comme nouvelle version par défaut. Si le contrôle gagne, vous avez appris ce qui ne fonctionne pas. En cas de résultat non concluant, testez un autre élément ou augmentez la taille de l’échantillon.

Étape 7 : Itérer et optimiser – Utilisez les enseignements de votre test pour alimenter les tests futurs. Si vous découvrez que les témoignages améliorent les conversions, testez différents types de témoignages. Si une couleur de bouton s’avère plus performante, testez-la sur d’autres pages. Les tests continus instaurent une culture d’optimisation qui génère des améliorations cumulatives dans le temps.

De nombreuses organisations compromettent leurs efforts de split testing par des erreurs évitables. Tester plusieurs variables simultanément rend impossible l’identification du changement responsable des résultats. Testez toujours une seule variable à la fois pour garder une causalité claire. Arrêter les tests trop tôt est une autre erreur critique—les premiers résultats peuvent être trompeurs à cause de la variation aléatoire, et il vous faut un échantillon suffisant pour obtenir des conclusions fiables.

Ignorer la signification statistique conduit à mettre en place des changements qui semblent efficaces mais qui sont simplement dus au hasard. Vérifiez toujours que vos résultats atteignent le seuil de confiance prédéfini avant toute décision. Négliger les facteurs externes comme les tendances saisonnières, les campagnes marketing ou les modifications du site peut fausser les résultats. Si vous réalisez un test pendant une période de forte promotion ou de vacances, les résultats pourraient ne pas refléter le comportement habituel des utilisateurs.

Tester sur un trafic insuffisant signifie que vous n’atteindrez jamais la signification statistique, rendant le test non concluant. Si votre site a peu de trafic, envisagez d’utiliser les méthodes statistiques bayésiennes ou de tester des éléments à plus fort impact susceptibles de générer des effets plus importants. Modifier les paramètres du test en cours de route compromet la validité statistique des résultats. Définissez vos paramètres avant le lancement et respectez-les.

Alors que le split testing se concentre sur la comparaison de deux versions, le test multivarié permet de tester plusieurs variables simultanément. Par exemple, vous pouvez tester deux titres combinés à deux images différentes, créant ainsi quatre combinaisons au total. Cependant, le test multivarié requiert des tailles d’échantillon bien plus grandes car le trafic est réparti entre plus de variantes. On le recommande généralement uniquement pour les sites à très fort trafic.

La segmentation de l’audience ajoute une couche supplémentaire de sophistication. Vous pouvez découvrir que différents segments d’audience réagissent différemment aux variantes. Par exemple, le trafic venant des réseaux sociaux pourrait préférer un ton décontracté et conversationnel, tandis que le trafic organique privilégie une approche plus professionnelle. En segmentant vos résultats, vous pouvez identifier ces tendances et potentiellement adopter différentes versions selon le segment, maximisant ainsi la performance globale.

En marketing d’affiliation, le split testing doit se concentrer sur les indicateurs ayant un impact direct sur le chiffre d’affaires. Le taux de conversion est fondamental : il s’agit du pourcentage de visiteurs qui accomplissent une action souhaitée. Le taux de clics (CTR) mesure le pourcentage de personnes qui cliquent sur votre appel à l’action. La valeur moyenne du panier (AOV) montre si les variantes influencent les montants d’achat. La valeur vie client (CLV) indique si les variantes testées attirent des clients de meilleure qualité qui achètent à plusieurs reprises.

Le taux de rebond révèle si votre variante retient les visiteurs ou les fait partir immédiatement. Le temps passé sur la page indique le niveau d’engagement. Le revenu par visiteur combine taux de conversion et valeur du panier en un seul indicateur. Pour les programmes d’affiliation, il est essentiel de suivre quelles variantes génèrent les prospects les plus qualifiés pour vos marchands—une variante peut augmenter le trafic mais attirer des visiteurs de moindre qualité qui ne convertissent pas.

Le split testing transforme le marketing d’un art basé sur l’intuition en une science fondée sur les données. L’effet cumulatif d’une optimisation continue est puissant : une amélioration de 10 % du taux de conversion, multipliée par des milliers de visiteurs chaque mois, se traduit par des gains de revenus considérables. Les entreprises qui adoptent le split testing surpassent systématiquement celles qui se fient à l’instinct. PostAffiliatePro fournit l’infrastructure de suivi et les capacités d’analyse nécessaires pour réaliser des tests A/B sophistiqués sur l’ensemble de votre réseau d’affiliés, vous permettant d’identifier les variantes gagnantes et de les déployer à grande échelle pour un impact maximal.

Maîtrisez le split testing pour maximiser les taux de conversion de votre programme d'affiliation. PostAffiliatePro fournit des outils avancés de suivi et d'analyse pour vous aider à réaliser des tests A/B efficaces et à identifier ce qui génère vos meilleurs résultats.

Découvrez pourquoi les tests A/B sont cruciaux pour l’optimisation des conversions. Apprenez comment les tests A/B améliorent les conversions, réduisent les ris...

Découvrez ce qu'est le test A/B (split testing) sur Facebook et comment l'utiliser pour optimiser vos campagnes publicitaires. Explorez les meilleures pratiques...

Le test A/B est une méthode d'expérimentation contrôlée où différentes versions d’un élément digital sont présentées à des segments d’audience afin de détermine...

Consentement aux Cookies

Nous utilisons des cookies pour améliorer votre expérience de navigation et analyser notre trafic. See our privacy policy.