Comment fonctionne le split testing ? Guide complet du test A/B

Découvrez comment fonctionne le split testing grâce à notre guide complet. Découvrez la méthodologie, la signification statistique, les meilleures pratiques et ...

Découvrez ce qu’est le test A/B (split testing) sur Facebook et comment l’utiliser pour optimiser vos campagnes publicitaires. Explorez les meilleures pratiques, méthodes de configuration et stratégies éprouvées pour augmenter votre ROI.

Un test A/B sur Facebook est une expérience où deux variantes ou plus d'une publicité Facebook sont présentées à différents groupes de personnes afin de déterminer laquelle est la plus efficace pour générer des résultats souhaités comme des clics, des conversions ou des achats.

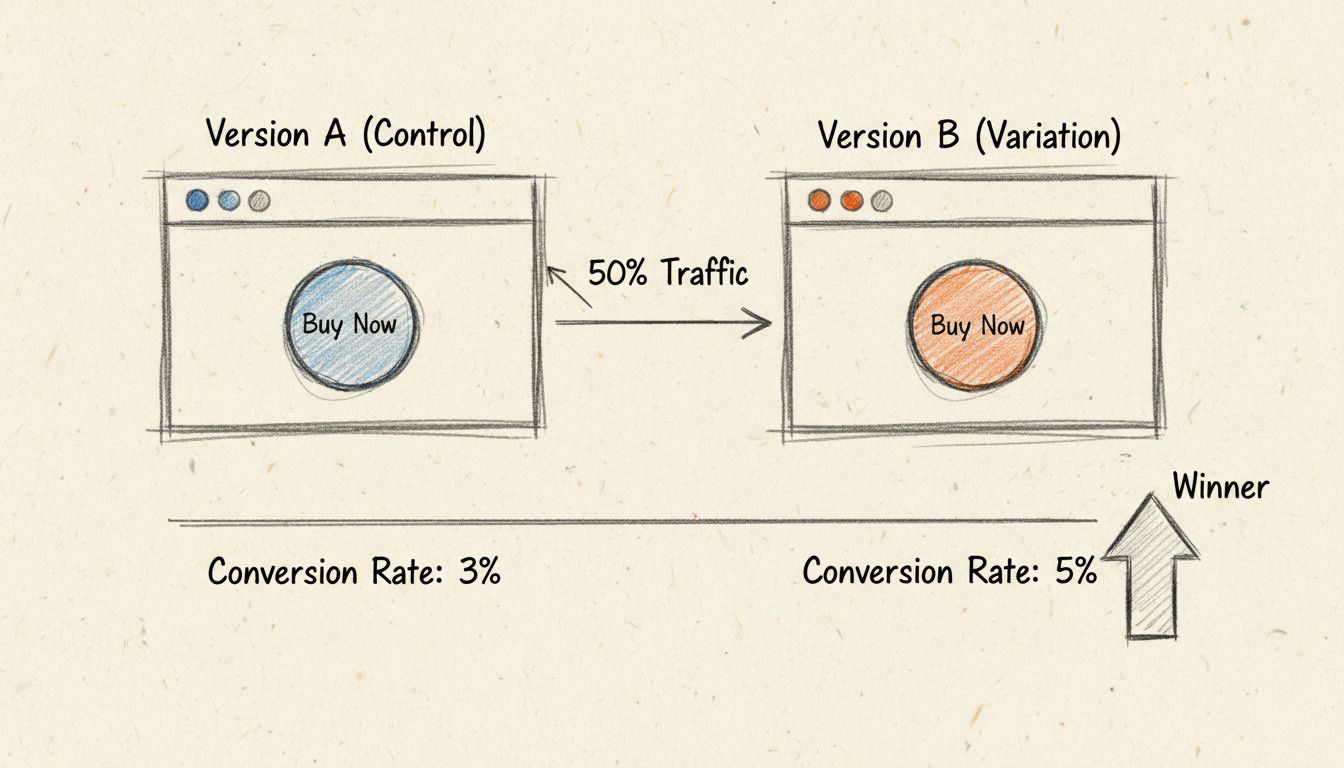

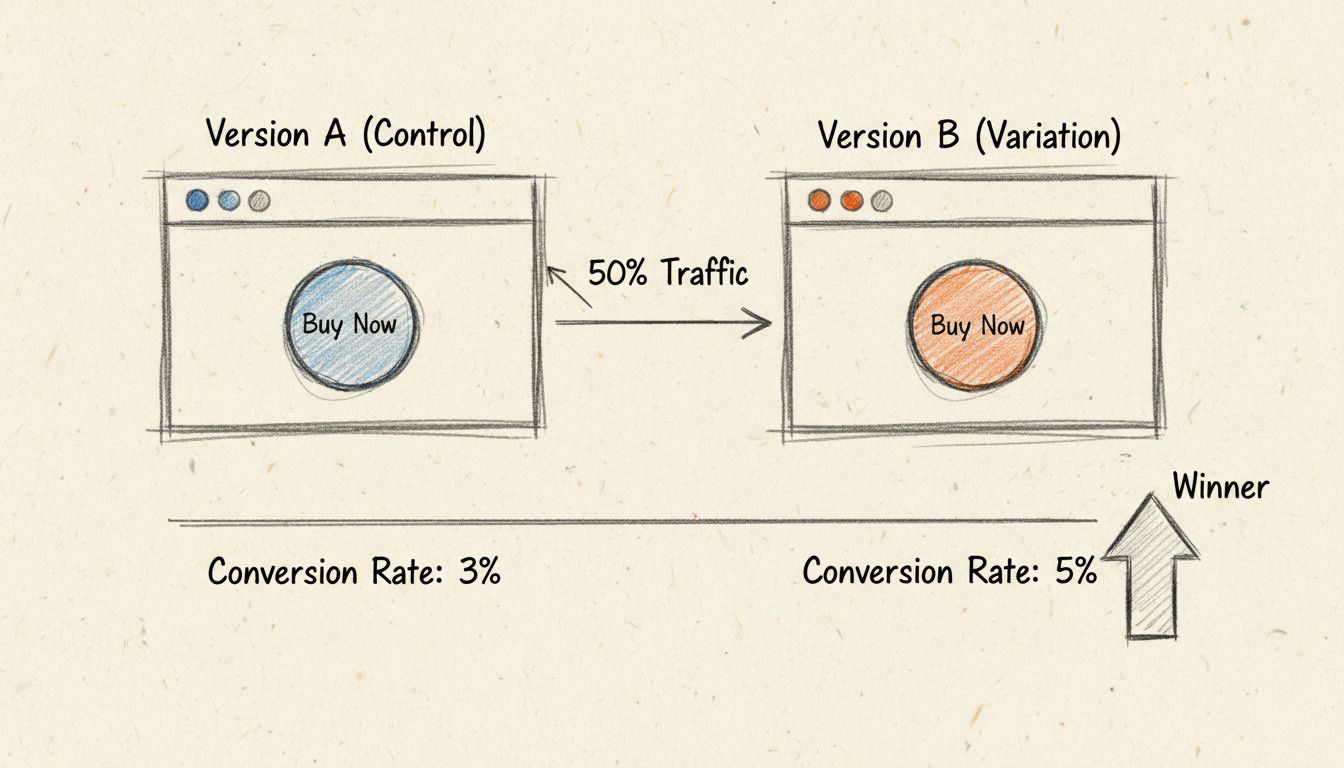

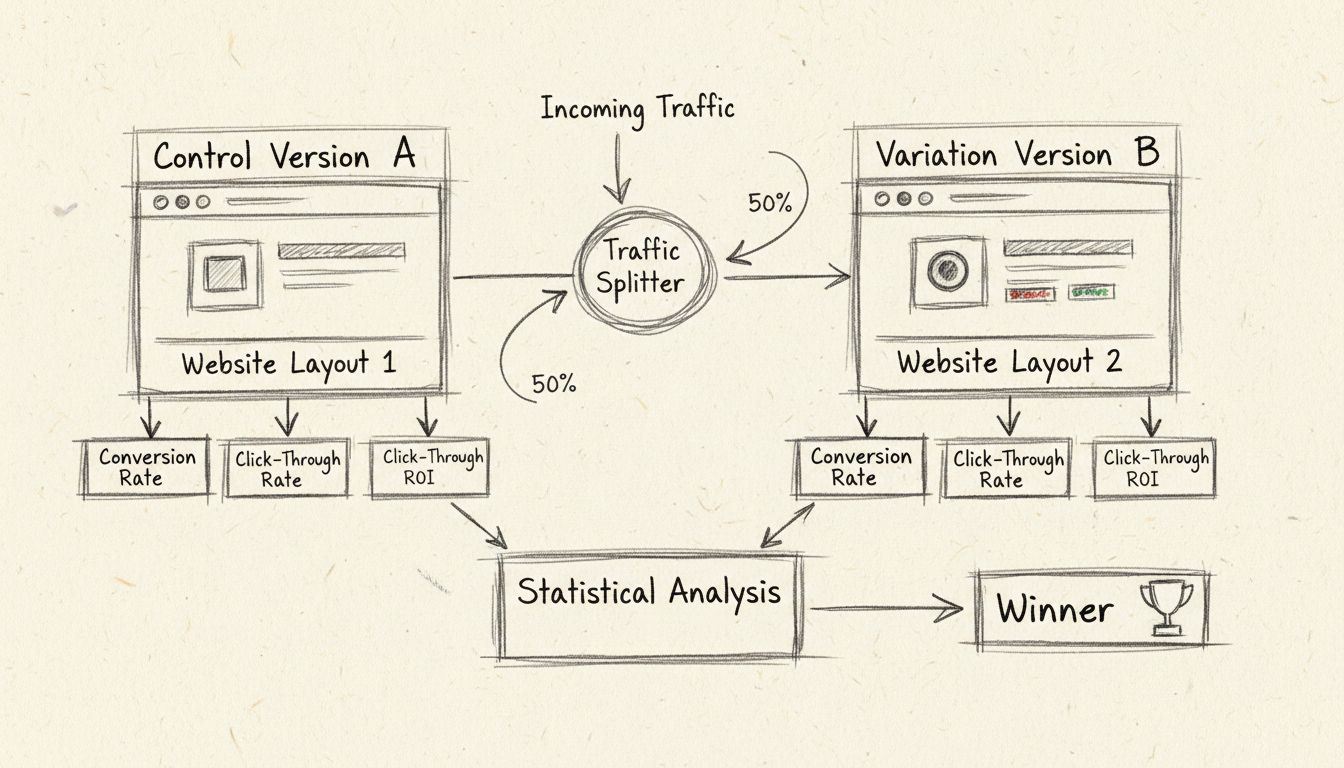

Un test A/B, également appelé split testing ou bucket testing, est une expérience contrôlée qui compare la performance de deux versions ou plus d’une publicité Facebook pour déterminer laquelle offre les meilleurs résultats. Cette méthodologie isole une seule variable à la fois—comme la création publicitaire, le ciblage de l’audience, le placement ou l’optimisation de la diffusion—et mesure comment ce changement spécifique impacte les indicateurs clés de performance de votre campagne. En menant ces expériences de façon systématique, les annonceurs peuvent prendre des décisions basées sur des données plutôt que sur des suppositions ou des préférences personnelles concernant ce qui pourrait fonctionner auprès de leur audience cible.

Le principe fondamental du test A/B est la validation statistique. Lorsque vous lancez un test A/B sur Facebook, la plateforme divise automatiquement votre audience en groupes séparés et attribués aléatoirement afin que chaque variante reçoive une exposition égale et une collecte de données impartiale. Cette approche scientifique élimine le risque de chevauchement d’audience et fournit des analyses fiables pour savoir quelle version sera la plus performante si elle est étendue à l’ensemble de votre budget marketing. Les résultats sont généralement présentés avec un niveau de confiance, indiquant la probabilité que vous obteniez les mêmes résultats si vous réalisiez à nouveau le test.

L’outil de test A/B de Facebook fonctionne dans le Gestionnaire de publicités et nécessite de sélectionner l’option de split test lors de la création de la campagne—il n’est pas possible d’ajouter un test A/B à une campagne existante. Une fois votre objectif de campagne choisi, vous devez spécifier quelle variable vous souhaitez tester. La plateforme crée alors des ensembles de publicités distincts pour chaque variante, en veillant à ce que votre budget soit réparti équitablement (ou selon vos préférences de pondération) entre toutes les variantes. Cette structure garantit que chaque publicité reçoive suffisamment d’impressions et d’interactions pour générer des données statistiquement significatives.

L’algorithme de test A/B de Facebook est conçu pour minimiser les biais et maximiser la précision des données. Plutôt que de permettre à l’algorithme d’optimisation de Facebook de favoriser une publicité par rapport à une autre sur la base des premiers signaux de performance, le test A/B maintient une répartition budgétaire égale tout au long de la période de test. Cela signifie que, même si une variante semble mieux performer après quelques jours, elle ne recevra pas une part disproportionnée du budget, ce qui pourrait fausser vos résultats. Le test se poursuit pendant la durée que vous avez définie et, à la fin, Facebook calcule quelle variante a obtenu le coût par résultat le plus bas selon votre objectif de campagne.

| Variable testée | Description | Meilleur cas d’utilisation |

|---|---|---|

| Créatif | Différentes images, vidéos, textes, titres et appels à l’action | Tester quelle approche visuelle ou quel message résonne le mieux auprès de votre audience |

| Audience | Différents segments démographiques, centres d’intérêt, comportements ou audiences personnalisées | Identifier quel segment d’audience affiche la meilleure valeur de conversion |

| Emplacements | Emplacements automatiques versus placements spécifiques (Fil, Stories, Reels, etc.) | Déterminer quel emplacement publicitaire génère le meilleur ROI |

| Optimisation de diffusion | Différentes stratégies d’enchères et objectifs d’optimisation (clics, conversions, engagement) | Trouver la méthode d’optimisation la plus rentable pour votre objectif |

| Catalogue produit | Différents catalogues ou collections de produits (pour l’e-commerce) | Identifier quelle sélection de produits génère le plus de ventes |

Chacune de ces variables peut avoir un impact considérable sur la performance de votre campagne. Par exemple, tester différentes créations peut révéler qu’un design simple et minimaliste surpasse un design complexe et riche en fonctionnalités de 143 %, comme le montrent des études de cas réelles. De même, tester des audiences peut démontrer qu’un segment démographique spécifique affiche un coût par conversion 50 % plus bas que votre audience élargie, vous permettant ainsi d’affiner considérablement votre ciblage.

Le split testing n’est pas simplement une fonctionnalité « agréable à avoir »—c’est une exigence fondamentale pour optimiser la performance de vos publicités Facebook et maximiser votre retour sur investissement publicitaire. Sans test A/B, vous devinez simplement quels éléments de vos campagnes fonctionnent le mieux, et ces suppositions sont souvent erronées. Les recherches montrent que le split testing peut augmenter le ROI jusqu’à 10 fois lorsqu’il est correctement exécuté, transformant des campagnes peu performantes en canaux marketing très rentables. Les données récoltées grâce aux tests A/B servent non seulement à optimiser vos campagnes en cours, mais aussi à affiner votre stratégie marketing globale et votre processus créatif.

Au-delà des améliorations immédiates, le split testing offre des informations précieuses sur les préférences et comportements de votre audience. Par exemple, découvrir que votre audience répond mieux à une accroche narrative qu’à une description axée sur les fonctionnalités, ou que les vidéos surperforment largement les images statiques, vous apporte des connaissances applicables bien au-delà d’une seule campagne. Ces enseignements peuvent être appliqués à vos emails marketing, pages d’atterrissage, contenus réseaux sociaux, et autres canaux, créant un effet cumulatif sur l’efficacité globale de votre marketing.

Créer un test A/B dans le Gestionnaire de publicités Facebook requiert une approche stratégique. Il faut d’abord établir une hypothèse claire sur ce que vous souhaitez tester et pourquoi. Plutôt que de tester des variantes au hasard, le succès du split testing dépend d’une question précise : « Les publicités vidéo génèrent-elles un coût par conversion plus bas que les publicités image ? » ou « Notre tranche d’âge 25-34 ans convertit-elle mieux que la tranche 35-44 ans ? » Cette approche basée sur l’hypothèse garantit que vos résultats seront exploitables.

Ensuite, il faut déterminer l’allocation de votre budget. Un test A/B significatif nécessite une collecte de données suffisante, ce qui implique que chaque variante génère au moins 10 à 20 conversions avant d’en tirer des conclusions fiables. Si votre coût moyen par conversion est de 5 $, et que vous testez cinq créations différentes, il vous faudra un budget minimum de 250 à 500 $ pour obtenir des données statistiquement significatives. Toutefois, un budget plus élevé réduit la durée nécessaire pour atteindre la significativité statistique et fournit des données plus solides.

Avant de lancer votre test A/B, vous devez définir les indicateurs qui détermineront le succès ou l’échec. Les indicateurs les plus couramment utilisés incluent le coût par résultat (CPR), le coût par clic (CPC), le coût par acquisition (CPA), le taux de clics (CTR) et le retour sur investissement publicitaire (ROAS). Cependant, le choix du bon indicateur dépend entièrement de vos objectifs business et de votre objectif de campagne. Pour la plupart des entreprises, le coût par conversion est un excellent point de départ, car il est directement corrélé à la rentabilité et à la croissance.

Les annonceurs expérimentés suivent souvent le chiffre d’affaires généré par chaque conversion et utilisent le ROAS comme indicateur principal, car il tient compte de l’impact réel sur la rentabilité de chaque variante. Si vous menez une campagne de génération de leads, vous pouvez privilégier le coût par lead. Le principe clé est de sélectionner un seul indicateur principal pour vos premiers tests, car surveiller plusieurs indicateurs simultanément peut produire des résultats confus ou contradictoires. Par exemple, une publicité avec un excellent taux de clic peut afficher un mauvais coût par conversion, signifiant que les clics générés ne mènent pas à des actions de valeur.

La manière dont vous structurez votre test A/B dans la hiérarchie de campagne Facebook influence fortement la fiabilité des données. Pour tester différentes créations (images, textes, titres), il est recommandé de créer plusieurs publicités au sein du même ensemble, afin qu’elles partagent la même audience et les mêmes paramètres de ciblage. En revanche, pour tester des segments d’audience ou des emplacements, il faut créer des ensembles publicitaires distincts pour chaque variante, ce qui permet de contrôler l’allocation budgétaire et de garantir une exposition égale.

Un point crucial à prendre en compte est d’éviter la concentration budgétaire. L’algorithme de Facebook peut allouer le budget de manière agressive à la publicité qu’il perçoit comme « gagnante », ce qui fait qu’une variante reçoit parfois trois fois plus d’impressions qu’une autre, faussant ainsi vos résultats. Pour éviter cela, certains marketeurs avancés créent un ensemble publicitaire distinct pour chaque création avec un budget égal, assurant ainsi une collecte de données parfaitement équilibrée. Cette approche augmente les coûts globaux du fait de la concurrence entre ensembles pour la même audience, mais elle fournit des résultats scientifiquement plus fiables.

De nombreux annonceurs commettent des erreurs critiques lors de la mise en place de tests A/B, compromettant la qualité des données. L’erreur la plus fréquente consiste à arrêter un test trop tôt, souvent après seulement quelques heures ou jours, lorsqu’une variante semble nettement supérieure. En réalité, la performance peut évoluer fortement au fil du temps et ce qui semble perdant au bout de 24h peut s’avérer gagnant au bout de 7 jours. Facebook recommande de mener les tests A/B pendant au moins 4 à 14 jours pour tenir compte des variations quotidiennes de comportement et garantir une accumulation suffisante de données.

Une autre erreur fréquente est la sur-segmentation de votre audience. Lorsque vous créez trop de segments—par exemple, tester 2 genres × 5 centres d’intérêt × 5 tranches d’âge = 50 ensembles publicitaires différents—vous aboutissez à des segments très petits, coûteux à atteindre. Facebook doit travailler davantage pour trouver des utilisateurs correspondant à des critères trop spécifiques, ce qui augmente le coût pour mille impressions et complique la collecte de données significatives. Il est préférable de commencer par des segments larges et d’affiner progressivement selon les résultats, plutôt que de cibler trop précisément d’emblée.

Une fois votre test A/B terminé, Facebook fournit les résultats sous deux formats : un email de résultats et des données de performance visibles dans le Gestionnaire de publicités. La plateforme identifie un ensemble gagnant selon le coût par résultat le plus bas et indique un niveau de confiance, c’est-à-dire la probabilité d’obtenir le même résultat si vous refaisiez le test. Facebook considère généralement qu’il y a un gagnant lorsque le niveau de confiance atteint 75 % ou plus, ce qui signifie qu’il y a au moins 75 % de chances que la même variante l’emporte en cas de test répété.

Si vos résultats affichent un niveau de confiance faible (inférieur à 75 %), Facebook recommande de relancer le test sur une durée plus longue ou avec un budget plus élevé afin de collecter davantage de données. Cela arrive fréquemment lorsque deux variantes obtiennent des résultats très proches, rendant impossible la désignation d’un vainqueur. Une fois un gagnant identifié, vous avez plusieurs options : mettre en pause les variantes sous-performantes et amplifier la diffusion du gagnant, redistribuer le budget pour privilégier les meilleurs tout en maintenant un minimum pour les autres, ou créer une nouvelle campagne en utilisant la variante gagnante comme référence pour le prochain test.

Les annonceurs expérimentés utilisent une méthodologie progressive, testant d’abord de grandes variantes avant d’affiner selon les résultats. Par exemple, vous pouvez d’abord tester deux approches créatives radicalement différentes (design minimaliste contre design riche en fonctionnalités) sur une audience large. Une fois la direction créative gagnante identifiée, vous testez des variantes dans cette direction (couleurs, titres, appels à l’action différents). Cette approche en entonnoir maximise les apprentissages tout en limitant le gaspillage budgétaire sur des variantes peu pertinentes pour votre audience.

Une autre stratégie avancée est le test continu, qui consiste à consacrer une petite partie de votre budget à tester de nouvelles variantes, tandis que la majorité finance les gagnantes éprouvées. Cette méthode permet de découvrir sans cesse de nouvelles opportunités d’amélioration tout en assurant une performance stable et prévisible pour vos campagnes principales. Les fonctionnalités avancées de suivi de PostAffiliatePro rendent cette stratégie particulièrement efficace, car vous pouvez surveiller les performances de multiples variantes et allouer automatiquement le budget en fonction des données en temps réel.

Facebook propose plusieurs méthodologies de test au-delà du split testing traditionnel. L’optimisation Créative Dynamique vous permet de télécharger plusieurs éléments créatifs et de laisser l’algorithme de Facebook tester automatiquement les combinaisons pour diffuser celles qui performent le mieux. Cette méthode diffère du split testing car Facebook contrôle l’allocation budgétaire et peut réorienter les ressources en temps réel. La Créative Dynamique est idéale lorsque vous disposez de nombreux éléments et souhaitez que Facebook optimise automatiquement, tandis que le test A/B est préférable si vous voulez un contrôle précis et une rigueur scientifique.

Les outils Brand Lift et Conversion Lift offrent des analyses plus complètes que le split testing en mesurant l’impact incrémental de vos publicités comparé à un groupe témoin non exposé. Ces outils sont précieux pour les campagnes à gros budget où vous souhaitez comprendre non seulement quelle publicité fonctionne le mieux, mais aussi quelle part de vos résultats business est réellement attribuable à vos efforts publicitaires. Cependant, ces outils nécessitent un budget plus important et des périodes de test plus longues que le split testing classique.

L’objectif ultime du split testing est de maximiser le retour sur investissement publicitaire par l’optimisation continue de chaque élément de vos campagnes. Des études de cas réelles démontrent l’impact du test A/B : une entreprise a réduit son coût d’acquisition de 4 433 $ à 123,45 $ par vente en testant systématiquement ses textes et créations, soit une réduction de 96,72 %. Un autre exemple montre une amélioration de plus de 100 % du coût par conversion simplement en changeant l’image publicitaire.

De tels résultats ne sont pas des exceptions, mais la conséquence attendue d’un split testing discipliné et systématique. En testant une variable à la fois, en collectant suffisamment de données et en agissant sur les résultats, vous améliorez continuellement la performance de vos campagnes. Combiné à la plateforme de suivi et d’analyse de PostAffiliatePro, le split testing devient encore plus puissant, car vous pouvez suivre les performances sur plusieurs campagnes, identifier les tendances gagnantes et appliquer ces apprentissages à l’ensemble de votre portefeuille d’affiliation.

Maîtrisez le split testing et l’optimisation de vos campagnes d’affiliation grâce aux outils de suivi et d’analyse avancés de PostAffiliatePro. Suivez la performance de plusieurs variantes publicitaires et maximisez votre ROI grâce à des données concrètes.

Découvrez comment fonctionne le split testing grâce à notre guide complet. Découvrez la méthodologie, la signification statistique, les meilleures pratiques et ...

Découvrez pourquoi les tests A/B sont cruciaux pour l’optimisation des conversions. Apprenez comment les tests A/B améliorent les conversions, réduisent les ris...

Le test A/B est une méthode d'expérimentation contrôlée où différentes versions d’un élément digital sont présentées à des segments d’audience afin de détermine...

Consentement aux Cookies

Nous utilisons des cookies pour améliorer votre expérience de navigation et analyser notre trafic. See our privacy policy.