Les mots-clés LSI sont-ils importants pour le SEO en 2025 ?

Découvrez la vérité sur les mots-clés LSI en 2025. Apprenez pourquoi Google n’utilise pas LSI, ce qui compte réellement pour le classement SEO, et comment optim...

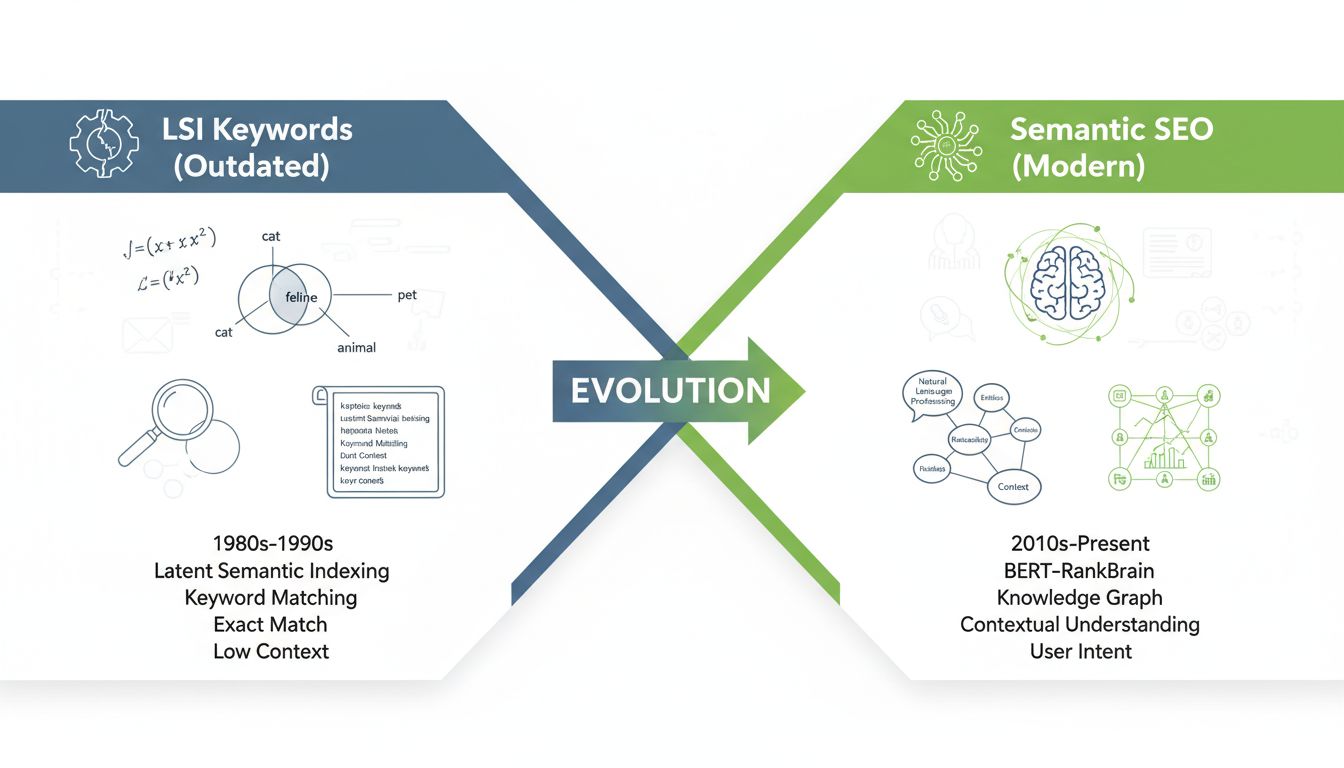

Non, Google n’utilise pas les mots-clés LSI (Latent Semantic Indexing). John Mueller de Google l’a confirmé à plusieurs reprises : LSI est une technologie obsolète des années 1980 que Google n’a jamais adoptée. À la place, Google utilise des technologies avancées de recherche sémantique comme BERT, RankBrain et le Knowledge Graph pour comprendre le sens et le contexte du contenu.

L’expression « mots-clés LSI » circule dans le milieu du SEO depuis plus de dix ans, créant une confusion généralisée sur la façon dont Google classe réellement le contenu. Beaucoup de marketeurs pensent encore que l’inclusion de listes de termes sémantiquement liés est un facteur de classement, alors qu’en réalité, Google a abandonné cette approche bien avant que le terme ne devienne populaire dans les communautés SEO. Comprendre la différence entre la théorie LSI obsolète et la recherche sémantique moderne est crucial pour toute personne gérant des programmes d’affiliation ou créant du contenu qui doit bien se positionner en 2025.

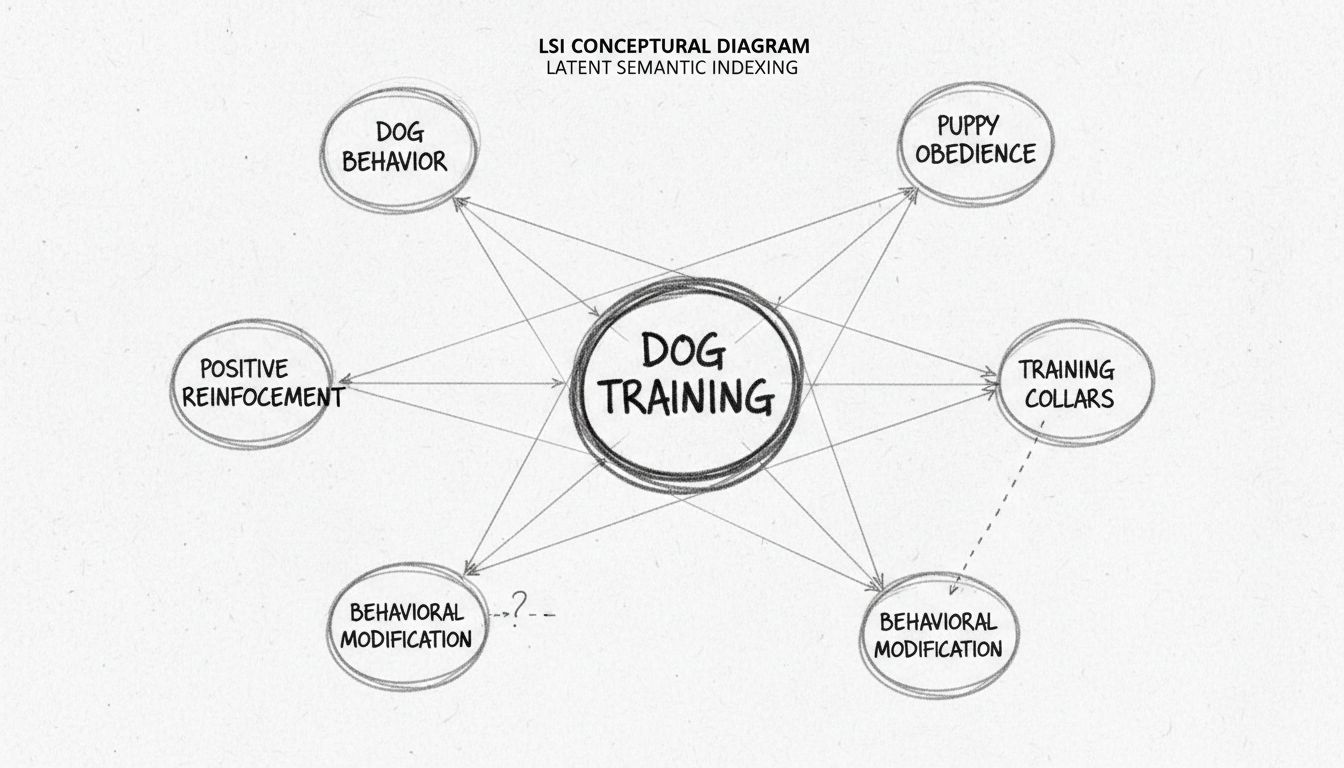

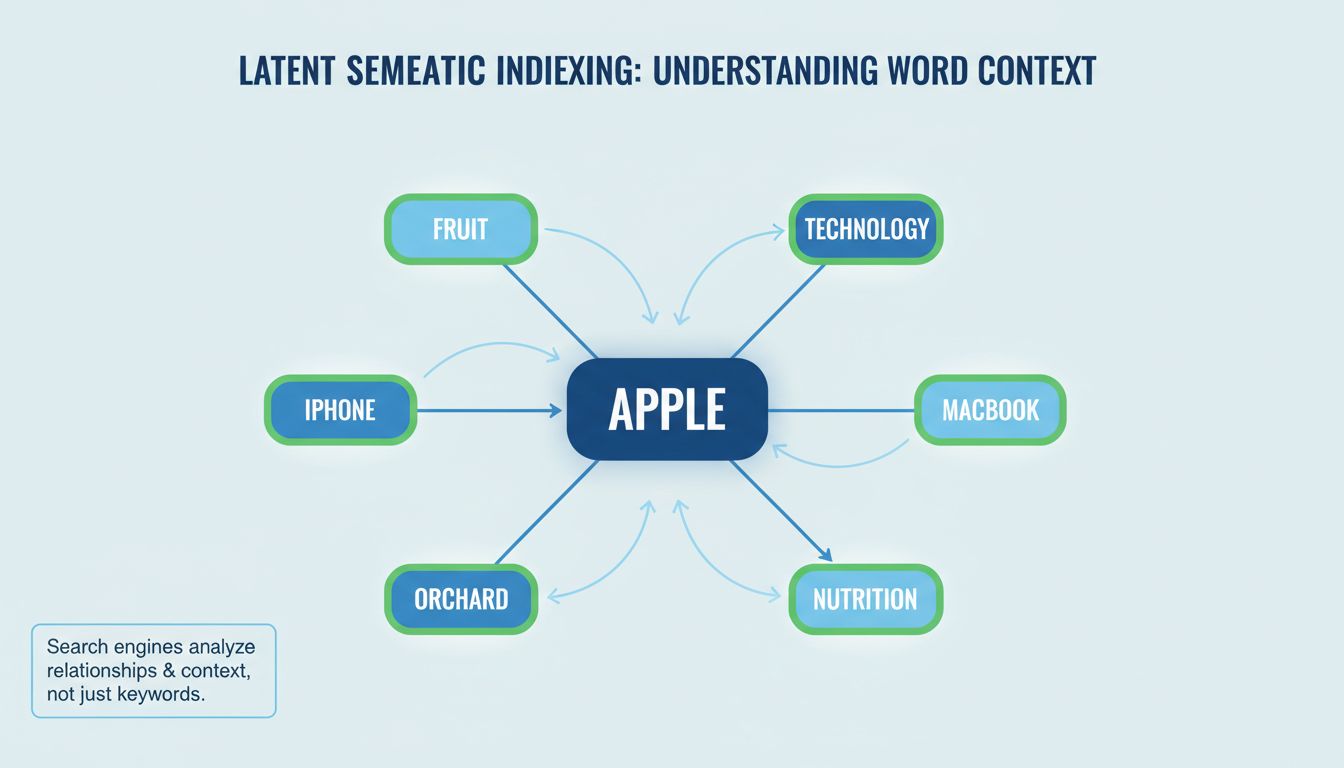

Le Latent Semantic Indexing était une technique mathématique développée à la fin des années 1980 pour analyser les relations entre les mots dans des ensembles de documents. La méthode utilisait la décomposition en valeurs singulières pour identifier des schémas cachés dans la cooccurrence des termes, permettant aux premiers systèmes de recherche de comprendre que « pomme » pouvait désigner soit le fruit, soit la société technologique selon le contexte. Bien que cela ait été innovant à l’époque, cette méthode n’a jamais été conçue pour s’adapter à des milliards de pages web, et Google a explicitement choisi de ne pas l’implémenter dans ses algorithmes de classement.

Google a évolué bien au-delà de la simple correspondance de mots-clés ou de l’analyse à la LSI. Le géant de la recherche utilise aujourd’hui des systèmes sophistiqués de traitement du langage naturel qui comprennent le sens à un niveau inimaginable avec la technologie des années 1980. La plus grande avancée est venue avec BERT (Bidirectional Encoder Representations from Transformers), introduit par Google en 2019. BERT analyse les mots dans leur contexte en examinant ceux qui les précèdent et les suivent, comprenant les nuances comme les prépositions et qualificatifs qui changent complètement le sens.

RankBrain, le système d’apprentissage automatique de Google introduit en 2015, s’occupe de l’interprétation des requêtes et les associe au contenu pertinent en se basant sur le sens plutôt que sur une correspondance exacte des mots-clés. Ce système apprend de milliards de recherches pour comprendre les schémas des recherches et ce qui satisfait réellement les besoins des utilisateurs. MUM (Multitask Unified Model), la dernière innovation de Google, étend cette capacité pour gérer des requêtes complexes en plusieurs étapes et même des entrées multimodales combinant texte et images.

Le Knowledge Graph représente un autre élément essentiel de la compréhension sémantique moderne. Cette immense base de données cartographie les entités — personnes, lieux, produits, concepts — et leurs relations. Lorsque Google traite une requête, il ne se contente plus de rechercher des pages contenant des mots précis ; il identifie les entités concernées et trouve le contenu qui en parle de manière pertinente. Cette approche basée sur les entités est fondamentalement différente du LSI, qui se concentrait sur la cooccurrence des mots plutôt que sur la compréhension de ce que sont réellement les choses.

Beaucoup de gens utilisent les termes « mots-clés LSI » et « mots-clés sémantiques » de façon interchangeable, mais cette confusion masque une distinction importante. Les mots-clés LSI font référence à un algorithme mathématique précis que Google n’a jamais utilisé à grande échelle. Les mots-clés sémantiques, en revanche, désignent les mots et expressions contextuellement liés à votre sujet principal et qui aident les moteurs de recherche à appréhender l’étendue de votre contenu. La confusion est née car les outils SEO avaient besoin d’un moyen pour décrire les termes associés, et « mots-clés LSI » est devenu un raccourci pratique, même s’il est techniquement inexact.

La différence pratique est significative pour la stratégie éditoriale. Courir après des listes de mots-clés LSI aboutit souvent à une écriture forcée et artificielle, où l’on tente d’inclure chaque terme suggéré, même s’il ne s’intègre pas naturellement dans le contenu. Cette méthode peut en réalité nuire au classement, car les moteurs de recherche modernes pénalisent les contenus artificiellement optimisés ou manquant de cohérence réelle. Le SEO sémantique, à l’inverse, consiste à comprendre en profondeur son sujet et à l’expliquer clairement, ce qui implique naturellement le vocabulaire contextuel que les moteurs de recherche reconnaissent comme des signaux d’expertise et d’exhaustivité.

| Aspect | Mots-clés LSI | SEO sémantique |

|---|---|---|

| Technologie utilisée | Algorithme mathématique des années 1980 | NLP moderne, BERT, RankBrain, Knowledge Graph |

| Implémentation par Google | Jamais utilisé à grande échelle | Système de classement central |

| Méthode d’optimisation | Insertion de listes de mots-clés | Couverture complète du sujet |

| Qualité rédactionnelle | Souvent forcée et artificielle | Naturelle, centrée sur le lecteur |

| Impact sur le classement | Aucun (direct) | Significatif (indirect via la clarté) |

| Reconnaissance d’entités | Non applicable | Centrale pour la compréhension |

| Correspondance avec l’intention utilisateur | Limitée | Interprétation avancée |

Lorsque Google analyse une page web, il ne se contente pas de compter les occurrences de mots-clés ni de rechercher des listes prédéfinies de termes associés. Il analyse l’intégralité de la page pour comprendre de quoi elle parle réellement, quelles entités elle mentionne et dans quelle mesure elle répond aux besoins des utilisateurs. Cette interprétation s’effectue par plusieurs couches d’analyse qui collaborent pour produire une compréhension globale du sens du contenu.

Le traitement du langage naturel permet à Google d’analyser la structure des phrases, d’identifier les relations grammaticales et de comprendre comment les mots se modifient entre eux. C’est pourquoi une page sur « recettes de tarte aux pommes » est comprise différemment d’une page sur « spécifications des ordinateurs Apple », bien qu’elles contiennent toutes deux le mot « pomme ». Le contexte autour — des mots comme « recette », « cuisson », « ingrédients » versus « ordinateur », « logiciel », « processeur » — fournit les signaux sémantiques qui distinguent ces sujets.

La reconnaissance d’entités va plus loin en identifiant les éléments spécifiques mentionnés dans le contenu. Lorsque Google lit « Steve Jobs », il ne voit pas seulement un nom ; il reconnaît une personne précise avec des attributs, des relations et une importance historique. Le Knowledge Graph relie alors cette entité à des concepts associés comme Apple Inc., l’innovation, la technologie ou l’entrepreneuriat. Ce réseau de relations aide Google à comprendre non seulement le sujet de la page, mais aussi sa place dans le paysage global des connaissances.

Les représentants de Google ont été très clairs sur leur position concernant les mots-clés LSI. En 2019, John Mueller, Search Advocate chez Google, a déclaré directement sur Twitter : « Les mots-clés LSI n’existent pas — toute personne affirmant le contraire se trompe, désolé. » Ce n’était pas un commentaire anodin mais une clarification délibérée visant à corriger une idée reçue persistante dans l’industrie du SEO. Mueller a réitéré cette position à maintes reprises, soulignant que les systèmes de classement de Google n’utilisent pas le latent semantic indexing sous quelque forme que ce soit.

La raison de ce rejet est simple : le LSI a été conçu pour de petites collections de documents statiques dans des environnements contrôlés. Il n’a jamais été pensé pour l’échelle, la diversité et la dynamique du web moderne. Les fondateurs de Google ont compris très tôt que les approches de type LSI ne conviendraient pas pour classer des milliards de pages sur d’innombrables sujets et langues. Ils ont donc investi dans des systèmes d’apprentissage automatique capables d’apprendre du comportement réel des utilisateurs et de s’adapter continuellement à de nouveaux schémas.

De plus, l’approche mathématique du LSI pour trouver des relations sémantiques est grossière comparée à ce que peuvent accomplir les réseaux neuronaux. Un réseau neuronal entraîné sur des milliards de documents peut apprendre des relations beaucoup plus fines entre les concepts qu’un modèle mathématique analysant la cooccurrence des termes. C’est pourquoi BERT et les systèmes similaires sont bien plus efficaces pour comprendre les nuances, le contexte et le sens du langage que n’importe quel algorithme des années 1980.

Même si les mots-clés LSI n’influencent pas eux-mêmes le classement, le principe sous-jacent — le fait que les moteurs de recherche tiennent compte des relations sémantiques et du sens contextuel — a bel et bien un impact sur la manière dont les pages sont positionnées. La différence, c’est que la compréhension sémantique moderne est bien plus sophistiquée et fonctionne à un niveau plus profond que la simple correspondance de mots-clés ou l’analyse de cooccurrence des termes. Lorsque vous rédigez un contenu qui couvre en profondeur un sujet et explique clairement les concepts, vous créez naturellement les signaux sémantiques que les moteurs de recherche modernes reconnaissent et valorisent.

Une couverture complète du sujet est l’un des signaux sémantiques les plus importants. Lorsqu’une page aborde un sujet sous plusieurs angles, inclut des notions complémentaires et explique les relations entre les idées, les moteurs de recherche l’interprètent comme un signe d’expertise et d’utilité. C’est pourquoi les contenus longs surpassent souvent les articles plus courts — non pas parce que la longueur est un facteur de classement, mais parce que la profondeur permet une expression sémantique plus complète. Un article de 500 mots sur « les méthodes d’infusion du café » mentionnera peut-être espresso, filtre et presse française, mais un guide complet de 3 000 mots pourra explorer chaque méthode en détail, expliquer la science de l’extraction, le choix du matériel et les erreurs courantes. Ce contenu plus long incorpore naturellement plus de signaux sémantiques car il couvre le sujet de façon plus exhaustive.

La clarté des entités est un autre signal sémantique crucial. Lorsque vous définissez clairement les entités abordées dans votre contenu et expliquez leurs relations, vous aidez les moteurs à comprendre le sens de votre texte. Si vous écrivez sur des logiciels de marketing d’affiliation, bien différencier les différentes plateformes, expliquer ce qui rend chacune unique et exposer leur rapport à différents modèles d’affaires apporte une clarté sémantique qui aide Google à saisir la portée et la pertinence de votre contenu.

Savoir que Google n’utilise pas les mots-clés LSI mais accorde une grande importance à la signification sémantique doit transformer fondamentalement votre approche de la création de contenu. Plutôt que de rechercher des listes de mots-clés LSI à intégrer de force dans vos textes, concentrez-vous sur la compréhension approfondie de votre sujet et son explication claire. Cette approche produit un meilleur contenu pour vos lecteurs et de meilleurs signaux pour les moteurs de recherche.

Commencez par rechercher les questions que votre audience se pose réellement sur votre sujet. Utilisez la section « Autres questions posées » de Google, les suggestions de saisie automatique, et des outils comme AnswerThePublic pour bien cerner l’intention utilisateur. Ces sources révèlent les relations sémantiques qui comptent pour les vrais internautes, pas des listes théoriques de mots-clés. En structurant votre contenu pour répondre à ces questions de façon complète, vous incorporez naturellement le vocabulaire et les concepts reconnus comme pertinents par les moteurs.

Étudiez les pages les mieux classées pour vos mots-clés cibles, mais ne les analysez pas pour en extraire des listes de mots-clés LSI. Observez plutôt comment elles structurent l’information, quels sous-thèmes elles couvrent, quelles entités elles mentionnent et comment elles expliquent les relations entre les concepts. Cette analyse révèle l’étendue sémantique attendue par Google pour votre sujet. Si toutes les pages bien positionnées abordent « les structures de commissions d’affiliation », « le traitement des paiements » et « la prévention de la fraude » en plus de votre sujet principal, ce ne sont pas des mots-clés LSI à forcer — ce sont des composantes essentielles d’une couverture exhaustive à traiter naturellement.

Malgré des années de clarifications de la part de Google, plusieurs mythes sur le LSI continuent de circuler dans les communautés SEO et les formations. Une idée répandue est que les outils de mots-clés LSI donnent une vision privilégiée de l’algorithme de classement de Google. En réalité, ces outils affichent simplement des termes associés et des synonymes — des informations disponibles gratuitement via les fonctionnalités de recherche de Google. Le terme « LSI » est purement marketing ; les outils ne procèdent à aucune analyse de latent semantic indexing.

Un autre mythe suggère qu’il faut inclure un nombre ou un pourcentage précis de mots-clés LSI pour optimiser le classement. Cette idée conduit à une écriture stéréotypée et peu naturelle qui nuit à la qualité du contenu. Les moteurs de recherche modernes évaluent le contenu dans son ensemble, sans valider une checklist de mots-clés. Une page qui intègre naturellement des concepts pertinents tout en restant agréable à lire et utile surpassera une page qui accumule artificiellement des mots-clés mais est maladroite à la lecture.

Certains marketeurs pensent encore que les mots-clés LSI peuvent compenser un contenu pauvre ou peu qualitatif. C’est totalement faux. Ajouter des termes associés à un contenu superficiel ne le rend ni exhaustif ni légitime. Les moteurs de recherche évaluent la profondeur réelle de l’explication, la qualité de l’information et la capacité du contenu à répondre aux besoins des utilisateurs. Aucune variation de mots-clés ne remplacera jamais l’expertise et la couverture approfondie.

Plutôt que de courir après des mythes SEO dépassés, les responsables de programmes d’affiliation performants ont besoin d’outils qui leur montrent ce qui génère réellement des conversions et de l’engagement. PostAffiliatePro propose des analyses et un suivi complets qui vous indiquent précisément quelles stratégies de contenu, quels partenaires affiliés et quelles approches marketing donnent des résultats concrets. Au lieu de deviner si votre optimisation sémantique fonctionne, vous disposez de données tangibles sur les sources de trafic, les taux de conversion et l’attribution du chiffre d’affaires.

Les capacités avancées de reporting de PostAffiliatePro vous aident à comprendre la relation entre votre stratégie de contenu et les résultats business réels. Vous pouvez identifier quelles pages génèrent le trafic le plus qualifié, quels partenaires affiliés apportent les conversions les plus rentables et comment différentes approches de contenu impactent vos performances. Cette démarche basée sur la donnée est bien plus efficace que les conseils SEO génériques, car elle repose sur votre audience, votre marché et votre modèle économique spécifiques.

Le suivi en temps réel et les analyses détaillées de la plateforme vous permettent aussi d’identifier des opportunités d’optimisation que les outils SEO classiques pourraient manquer. Vous voyez précisément comment les utilisateurs interagissent avec votre contenu, à quel moment ils décrochent, et quels messages résonnent le plus. Ces insights vous permettent d’affiner votre stratégie éditoriale en fonction du comportement réel des utilisateurs, et non d’après des best practices théoriques.

La persistance des discussions sur les mots-clés LSI en 2025 traduit un décalage entre la théorie SEO obsolète et la réalité de la recherche moderne. Google a été clair et constant : les mots-clés LSI ne font pas partie de ses systèmes de classement. Ce qui compte, c’est la compréhension sémantique — la capacité des moteurs à saisir de quoi parle réellement votre contenu, quelles entités il traite et dans quelle mesure il répond aux besoins des utilisateurs.

Pour les marketeurs affiliés et les créateurs de contenu, cette clarification doit être libératrice. Plutôt que de passer du temps à rechercher des listes de mots-clés LSI et à tenter de les intégrer à tout prix, consacrez cet effort à approfondir votre sujet et à l’expliquer avec clarté. Écrivez d’abord pour votre audience, optimisez ensuite pour les moteurs, et soyez confiant dans le fait qu’un contenu complet et bien structuré intégrera naturellement les signaux sémantiques reconnus et valorisés par les algorithmes modernes.

L’avenir du SEO ne repose pas sur des astuces de mots-clés ou de l’optimisation mécanique — il s’agit de créer un contenu réellement utile, qui démontre votre expertise et répond aux vrais besoins des utilisateurs. En misant sur la clarté sémantique, une couverture exhaustive des sujets et une compréhension basée sur les entités, vous produirez des contenus qui se classent bien non seulement dans les résultats de recherche traditionnels de Google, mais aussi dans les réponses générées par l’IA et sur les plateformes de recherche émergentes. C’est là le véritable avantage concurrentiel en 2025 et au-delà.

Arrêtez de deviner le SEO et commencez à suivre ce qui fonctionne réellement. Les analyses avancées de PostAffiliatePro vous aident à comprendre quelles stratégies de contenu génèrent de vraies conversions d’affiliation. Obtenez les insights dont vous avez besoin pour construire un programme d’affiliation rentable.

Découvrez la vérité sur les mots-clés LSI en 2025. Apprenez pourquoi Google n’utilise pas LSI, ce qui compte réellement pour le classement SEO, et comment optim...

Découvrez comment l’Indexation Sémantique Latente (LSI) renforce la pertinence contextuelle de votre contenu, améliore son classement dans les moteurs de recher...

Découvrez comment l'Indexation Sémantique Latente influence le SEO en 2025. Apprenez comment les mots-clés LSI améliorent le classement, la pertinence du conten...

Consentement aux Cookies

Nous utilisons des cookies pour améliorer votre expérience de navigation et analyser notre trafic. See our privacy policy.